BERT AI Model: Pahami Cara Kerja dan Bedanya dengan GPT

Saat ini, kecerdasan buatan (AI) semakin canggih, terutama dalam bidang Natural Language Processing (NLP). Salah satu model yang paling berpengaruh adalah BERT AI Model. Model ini dirancang untuk memahami teks dengan lebih baik dibandingkan model NLP sebelumnya. Tapi, bagaimana cara kerja BERT? Dan apa bedanya dengan GPT yang banyak digunakan untuk chatbot seperti ChatGPT? Yuk, kita kupas tuntas!

Mengenal Apa Itu BERT AI Model

BERT (Bidirectional Encoder Representations from Transformers) adalah model AI berbasis deep learning yang dirancang untuk meningkatkan Natural Language Processing.

Dibuat oleh peneliti Google pada 2018, BERT terkenal karena kemampuannya memahami konteks kata dalam kalimat secara bidirectional—menganalisis hubungan antar kata dari kedua arah.

Model AI ini dibangun dengan arsitektur yang memadukan dua komponen, yaitu: Encoder Representations dan Transformer:

- Encoder bertugas mengubah teks input menjadi representasi yang lebih mudah dipahami oleh AI. Proses ini menghasilkan hidden state vector, yaitu daftar nilai yang menyimpan konteks tambahan.

- Kemudian transformer memanfaatkan informasi ini untuk mengenali pola atau membuat prediksi.

Menariknya, BERT hanya menggunakan bagian encoder dari arsitektur Transformer, berbeda dengan model AI lain yang menggunakan encoder dan decoder.

Encoder ini mampu memahami makna kata berdasarkan keseluruhan kalimat. Teknologi ini menjadi sangat efektif di berbagai bidang, seperti pencarian Google, biologi, hingga analisis data.

Jadi, jika kamu pernah merasa hasil pencarian Google makin relevan dengan maksud pencarianmu, itu karena BERT berperan di balik layar.

Baca Juga: Mengenal Apa Itu Website AI: Cari Tahu Fitur dan Contohnya

Bagaimana Cara Kerja BERT?

BERT AI Model bekerja dengan memahami konteks kata dalam sebuah kalimat secara lebih mendalam. Uniknya, BERT hanya menggunakan mekanisme encoder dari arsitektur transformer dengan langkah-langkah berikut ini:

- Tokenisasi: Teks dipecah menjadi unit kecil (token), termasuk kata atau sub-kata, agar bisa dipahami oleh model.

- Embedding: Setiap token dikonversi menjadi vektor numerik yang merepresentasikan maknanya dalam suatu ruang dimensi.

- Proses dalam Neural Network: Vektor ini diproses dalam jaringan saraf (neural network), di mana BERT menganalisis hubungan antar kata secara bidirectional, memahami makna dari keseluruhan teks, bukan hanya dari satu arah.

Kemudian dalam memproses langkah-langkah tersebut, BERT menggunakan dua teknik utama:

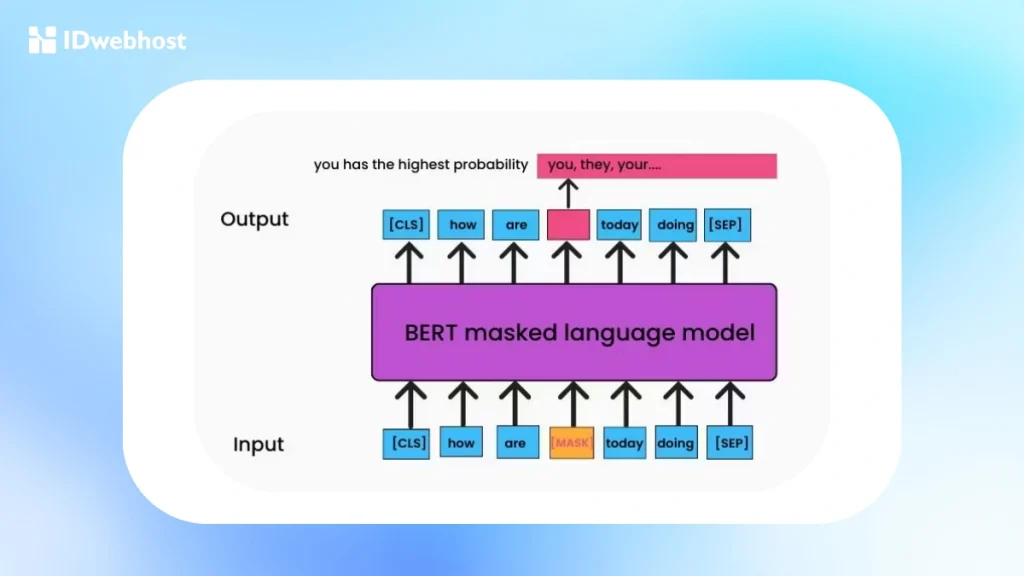

- Masked Language Model (MLM)

Saat dilatih, BERT secara acak menyembunyikan (masking) beberapa kata dalam kalimat dan mencoba menebaknya berdasarkan konteks kata-kata di sekitarnya.

Misalnya, dalam kalimat “Saya suka [MASK] di pagi hari,” BERT akan mempelajari berbagai kemungkinan kata yang sesuai, seperti “kopi” atau “teh,” bergantung pada pola bahasa alami yang telah dipelajarinya.

Teknik ini memungkinkan BERT memahami makna kata dalam berbagai konteks. - Next Sentence Prediction (NSP)

BERT juga dilatih untuk menentukan apakah dua kalimat berhubungan atau tidak.

Model ini diberikan dua kalimat—misalnya, “Hari ini hujan.” dan “Saya membawa payung.”—lalu BERT akan menilai apakah hubungan di antara keduanya logis atau tidak.

Kombinasi kedua teknik tersebut menjadikan BERT mampu memahami struktur bahasa secara lebih mendalam, sehingga hasil pencarian Google dan berbagai aplikasi NLP menjadi lebih akurat dan relevan.

Baca Juga: Cara Menggunakan Hugging Face: Apa Saja Fitur & Manfaatnya?

Contoh Penggunaan BERT

BERT telah merevolusi cara sistem AI memahami bahasa manusia. Model ini digunakan dalam berbagai tugas Natural Language Processing, termasuk:

- Klasifikasi Teks

BERT dapat mengkategorikan teks berdasarkan sentimen atau topik.

Contohnya, dalam analisis sentimen, BERT membantu mengidentifikasi apakah ulasan pelanggan bersifat positif, negatif, atau netral. - Question Answering (QA)

BERT dapat memahami pertanyaan dan menemukan jawaban dalam teks yang diberikan.

Contoh penerapannya ada di fitur Google Search, di mana jawaban langsung muncul di hasil pencarian tanpa perlu membuka situs. - Named Entity Recognition (NER)

BERT mengenali entitas penting dalam teks, seperti nama orang, organisasi, tanggal, atau lokasi.

Berguna untuk chatbot, analisis berita, atau pencarian informasi dalam dokumen besar.

Baca Juga: Adu Pintar Gemini dan ChatGPT sebagai Large Language Model

Aplikasi BERT dalam Kehidupan Sehari-hari

BERT bukan hanya untuk peneliti atau perusahaan teknologi besar—kamu mungkin menggunakannya setiap hari tanpa menyadarinya! Berikut beberapa aplikasi BERT yang mempermudah hidup kita:

- Pencarian Google

Google menggunakan BERT untuk memahami maksud pencarianmu secara lebih akurat.

Misalnya, jika kamu mencari “cara backup website tanpa plugin”, Google tidak hanya melihat kata kunci tetapi juga memahami konteksnya untuk memberikan hasil paling relevan. - Deteksi Spam

Email yang masuk ke folder spam bukan dipilih secara acak.

BERT membantu mengenali pola dalam pesan, seperti kata-kata mencurigakan, tautan berbahaya, atau penipuan, untuk memfilter email yang tidak diinginkan. - Penerjemahan Mesin

Layanan seperti Google Translate menggunakan BERT untuk memahami konteks dan makna kalimat secara lebih natural.

Ini membantu menghasilkan terjemahan yang lebih akurat dibanding hanya menerjemahkan kata per kata. - Chatbot dan Virtual Assistant

Asisten virtual seperti Google Assistant dan chatbot customer service menggunakan BERT untuk memahami pertanyaan pengguna dan memberikan respons yang lebih tepat.

Baca Juga: Jasper AI: Cara Kerja, Fitur Utama, Harga, dan Manfaatnya

Perbedaan BERT vs GPT

Banyak orang membandingkan BERT vs GPT karena keduanya merupakan model NLP berbasis Transformer. Meski sama-sama menjadi AI Model, tetapi BERT dan GPT memiliki perbedaan mendasar dalam arsitektur dan fungsinya.

Berikut adalah perbedaan utama antara BERT vs GPT:

Arsitektur Model

BERT (Bidirectional Encoder Representations from Transformers) memproses teks secara dua arah (bidirectional). Ini berarti model memahami kata berdasarkan konteks dari kedua sisi (sebelum dan sesudah kata tersebut).

Sebaliknya, GPT (Generative Pre-trained Transformer) menggunakan pendekatan satu arah (unidirectional), di mana model memprediksi kata berikutnya berdasarkan kata-kata sebelumnya.

Tujuan Pre-training

BERT dilatih menggunakan Masked Language Model (MLM), yaitu dengan menyembunyikan sebagian kata dalam teks dan melatih model untuk menebak kata yang hilang. Selain itu, BERT juga menggunakan Next Sentence Prediction (NSP) untuk memahami hubungan antar-kalimat.

GPT dilatih dengan Autoregressive Language Model (ARLM), di mana model memprediksi kata berikutnya dalam sebuah kalimat untuk membangun pemahaman bahasa yang lebih alami.

Pemahaman Konteks

BERT unggul dalam tugas yang membutuhkan pemahaman mendalam tentang teks, seperti analisis sentimen, klasifikasi teks, dan question-answering.

GPT lebih kuat dalam pembuatan teks yang mengalir secara alami, seperti chatbot, penulisan kreatif, dan pembuatan ringkasan teks.

Penerapan dalam NLP

BERT sering digunakan untuk pencarian informasi (Google Search), analisis teks, dan sistem tanya-jawab.

GPT lebih cocok untuk membuat konten, percakapan AI, dan penulisan otomatis.

Jadi, bisa dibilang, BERT adalah model yang fokus pada pemahaman teks, sedangkan GPT lebih berorientasi pada pembuatan teks baru.

Baca Juga: Meta AI WhatsApp Adalah: Ini Fungsi & Cara Mengaktifkannya

Kesimpulan

BERT AI Model adalah salah satu inovasi terbaik dalam dunia NLP karena kemampuannya memahami konteks secara lebih baik dibandingkan model sebelumnya.

Dengan arsitektur bidirectional dan teknik pelatihan unik seperti Masked Language Model (MLM) dan Next Sentence Prediction (NSP), BERT unggul dalam berbagai tugas NLP, terutama dalam analisis teks dan pencarian informasi.

Namun, jika kamu ingin membangun sistem yang dapat menghasilkan teks baru, maka GPT mungkin lebih cocok. Perbedaan antara BERT vs GPT inilah yang membuat keduanya memiliki keunggulan masing-masing.

Nah, kalau kamu sedang mengembangkan proyek AI berbasis BERT AI Model, kamu pasti butuh infrastruktur yang kuat dan andal. Gunakan layanan VPS Murah dari IDwebhost agar performa model AI kamu tetap optimal tanpa hambatan teknis!